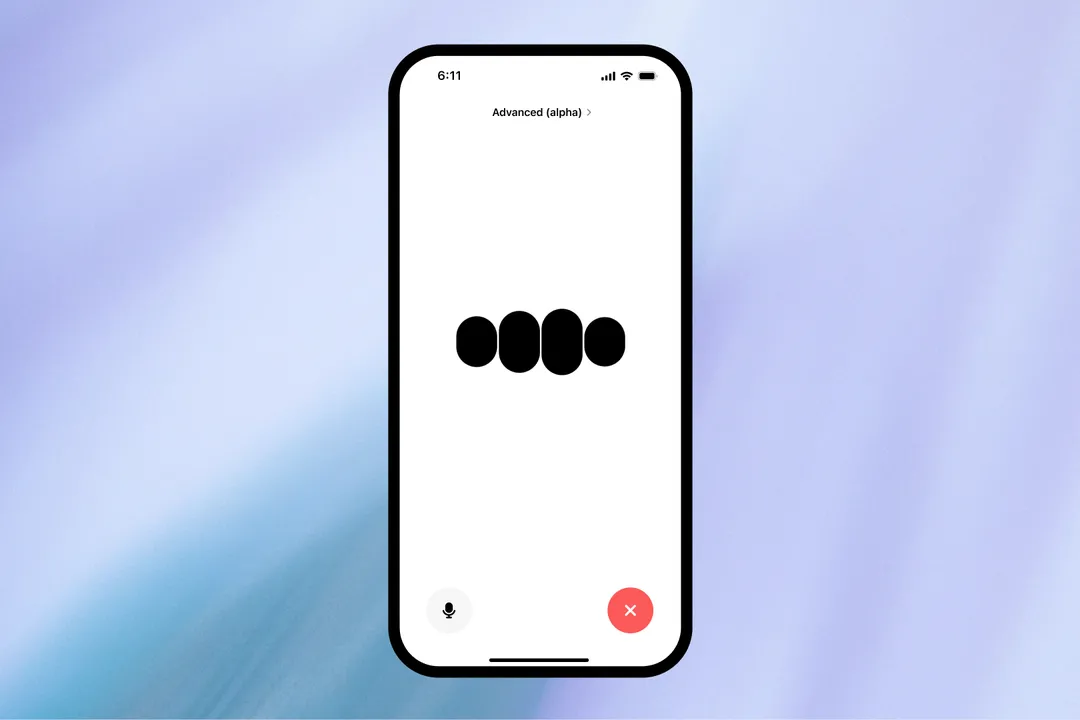

当地时间周二(7月30日),美国人工智能(AI)研究公司OpenAI宣布,即日起开始向部分ChatGPT Plus用户推出GPT-4o的语音模式。据OpenAI介绍,高级语音模式能提供更自然的实时对话,允许用户随时打断,并能感知和响应用户的情绪。实时响应和可打断对话是目前语音助手公认的技术难点。

OpenAI在今年5月推出了新版本大模型GPT-4o,同时还展示出了语音模式。该公司原定于6月底开始逐步向用户开放语音模式,但最终决定推迟至7月发布。语音模式将于今年秋季向所有ChatGPT Plus用户开放。

OpenAI周二表示:“通过逐步推出,我们可以密切监控使用情况,并根据实际反馈不断改进模型的能力和安全性。”该公司还透露,它仍在开发5月发布会期间展示的视频和屏幕共享功能。这些功能尚未确定推出时间。

因此,语音模式初期的功能将比较有限。例如,ChatGPT将无法使用计算机视觉功能,该功能可让聊天机器人通过智能手机的摄像头对用户的舞蹈动作提供语音反馈。

目前GPT-4o语音模式可使用四种预设声音,Juniper、Breeze、Cove和Ember,这些声音是与付费配音演员合作制作的。

此前,ChatGPT一款名为Sky的女性配音被指与好莱坞明星斯嘉丽·约翰逊十分相似。在收到约翰逊团队的律师函后,OpenAI暂停使用Sky语音。

OpenAI还表示,它已引入了新的过滤器,以确保软件能够发现并拒绝某些生成音乐或其他形式的受版权保护的音频的请求。对于AI公司而言,避免陷入法律纠纷已成为格外需要警惕的事项。

© 版权声明

本站提供的一切软件、教程和内容信息仅限用于学习和研究目的;不得将上述内容用于商业或者非法用途,否则,一切后果请用户自负。本站信息来自网络收集整理,版权争议与本站无关。您必须在下载后的24个小时之内,从您的电脑或手机中彻底删除上述内容。如果您喜欢该程序和内容,请支持正版,购买注册,得到更好的正版服务。我们非常重视版权问题,如有侵权请邮件与我们联系处理。敬请谅解!

THE END

![[图说]【喷嚏图卦20240808】让以色列痛苦的等待,也是惩罚的一部分-滴滴资源网](https://ddkd.net/wp-content/uploads/replace/39cb670e60a6c2a62de10a89fdaa6e31.jpeg)

![[图说]【喷嚏图卦20240802】人之为人的待遇-滴滴资源网](https://ddkd.net/wp-content/uploads/replace/c401f3d6aa5cb73bbf30bfffbdeb3ca8.jpeg)

暂无评论内容